Views: 51

O modelo substitui o laborioso processo de anotar grandes conjuntos de dados de pacientes manualmente.

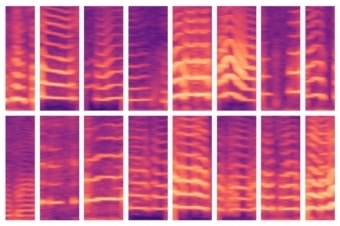

Fonte MIT por Rob Matheson | Um novo modelo desenvolvido pelo MIT automatiza uma etapa crítica no uso da Inteligencia Artificial para a tomada de decisão médica, na qual os especialistas geralmente identificam manualmente recursos importantes em conjuntos de dados de pacientes em massa. O modelo foi capaz de identificar automaticamente os padrões de voz de pessoas com nódulos nas cordas vocais (mostrado aqui) e, por sua vez, usar esses recursos para prever quais pessoas têm e não têm o distúrbio.

Cientistas da computação esperam acelerar o uso da inteligência artificial para melhorar a tomada de decisões médicas, automatizando uma etapa fundamental que geralmente é feita à mão – e isso está se tornando mais trabalhoso à medida que certos conjuntos de dados se tornam cada vez maiores.

O campo da análise preditiva é cada vez mais promissor para ajudar os médicos a diagnosticar e tratar pacientes. Os modelos de aprendizagem por máquina podem ser treinados para encontrar padrões em dados de pacientes para auxiliar no tratamento da sepse, projetar regimes de quimioterapia mais seguros e prever o risco de um paciente ter câncer de mama ou morrer na UTI, para citar apenas alguns exemplos.

Normalmente, os conjuntos de dados de treinamento consistem em muitos assuntos de doentes e saudáveis, mas com relativamente poucos dados para cada sujeito. Os especialistas devem então encontrar apenas esses aspectos – ou “recursos” – nos conjuntos de dados que serão importantes para fazer previsões.

Essa “engenharia de recursos” pode ser um processo trabalhoso e caro. Mas está se tornando ainda mais desafiador com o aumento dos sensores vestíveis, porque os pesquisadores podem monitorar mais facilmente a biometria dos pacientes por longos períodos, rastreando os padrões de sono, a marcha e a atividade da voz, por exemplo. Depois de apenas uma semana de monitoramento, os especialistas podem ter vários bilhões de amostras de dados para cada assunto.

Em um artigo apresentado na conferência Machine Learning for Healthcare, esta semana, pesquisadores do MIT demonstram um modelo que aprende automaticamente características preditivas de distúrbios das cordas vocais. Os recursos vêm de um conjunto de dados de cerca de 100 participantes, cada um com cerca de uma semana de dados de monitoramento de voz e vários bilhões de amostras, ou seja, um pequeno número de assuntos e uma grande quantidade de dados por assunto. O conjunto de dados contém sinais capturados de um pequeno sensor de acelerômetro montado no pescoço dos participantes.

Nos experimentos, o modelo utilizou características extraídas automaticamente desses dados para classificar, com alta precisão, pacientes com e sem nódulos nas cordas vocais. Estas são lesões que se desenvolvem na laringe, muitas vezes por causa de padrões de uso indevido de voz, como cantar ou gritar. É importante ressaltar que o modelo realizou essa tarefa sem um grande conjunto de dados rotulados à mão.

“Está se tornando cada vez mais fácil coletar conjuntos de dados de séries temporais longas. Mas você tem médicos que precisam aplicar seus conhecimentos para rotular o conjunto de dados ”, diz o autor principal, José Javier Gonzalez Ortiz, um estudante de PhD no Laboratório de Inteligência Artificial e Ciência da Computação do MIT (CSAIL). “Queremos remover essa parte manual para os especialistas e transferir toda a engenharia de recursos para um modelo de aprendizado de máquina”.

O modelo pode ser adaptado para aprender padrões de qualquer doença ou condição. Mas a capacidade de detectar os padrões diários de uso da voz associados a nódulos nas cordas vocais é um passo importante no desenvolvimento de métodos aperfeiçoados para prevenir, diagnosticar e tratar o distúrbio, dizem os pesquisadores. Isso pode incluir a criação de novas formas de identificar e alertar as pessoas sobre comportamentos vocais potencialmente prejudiciais.

Juntando-se a Gonzalez Ortiz no papel está John Guttag, o Professor de Ciência da Computação e Engenharia Elétrica de Dugald C. Jackson e chefe do Grupo de Inferência Dirigida por Dados da CSAIL; Robert Hillman, Jarrad Van Stan e Daryush Mehta, todos do Centro Hospitalar Geral de Massachusetts para Cirurgia de Laringe e Reabilitação de Voz; e Marzyeh Ghassemi, professor assistente de ciência da computação e medicina na Universidade de Toronto.

Aprendizado por recursos forçados

Durante anos, os pesquisadores do MIT trabalharam com o Centro de Cirurgia da Laringe e a Reabilitação da Voz para desenvolver e analisar dados de um sensor para rastrear o uso da voz durante todas as horas de vigília. O sensor é um acelerômetro com um nó que adere ao pescoço e está conectado a um smartphone. Conforme a pessoa fala, o smartphone reúne dados dos deslocamentos no acelerômetro.

Em seu trabalho, os pesquisadores coletaram uma semana desses dados – dados de “séries temporais” – de 104 indivíduos, metade dos quais foram diagnosticados com nódulos nas cordas vocais. Para cada paciente, havia também um controle correspondente, ou seja, um sujeito saudável de idade, sexo, ocupação e outros fatores semelhantes.

Tradicionalmente, os especialistas precisariam identificar manualmente os recursos que podem ser úteis para um modelo para detectar várias doenças ou condições. Isso ajuda a evitar um problema comum de aprendizado de máquina nos serviços de saúde: o sobre ajuste. É quando, no treinamento, um modelo “memoriza” dados do assunto em vez de aprender apenas as características clinicamente relevantes. Nos testes, esses modelos muitas vezes não conseguem discernir padrões semelhantes em assuntos anteriormente não vistos.

“Em vez de aprender características que são clinicamente significativas, um modelo vê padrões e diz: ‘Esta é Sarah, e eu sei que Sarah é saudável, e este é Peter, que tem um nódulo nas cordas vocais.’. Então, quando vir dados de Andrew, que tem um novo padrão de uso vocal, não será possível descobrir se esses padrões correspondem a uma classificação “, diz Gonzalez Ortiz.

O principal desafio, então, foi prevenir o sobre ajuste enquanto automatizava a engenharia manual de recursos. Para esse fim, os pesquisadores forçaram o modelo a aprender recursos sem informações sobre o assunto. Para sua tarefa, isso significava captar todos os momentos em que os sujeitos falam e a intensidade de suas vozes.

À medida que o modelo deles rastreia os dados de um sujeito, ele é programado para localizar segmentos de voz, que compreendem apenas cerca de 10% dos dados. Para cada uma dessas janelas de vozeamento, o modelo calcula um espectrograma, uma representação visual do espectro de frequências variando ao longo do tempo, que é frequentemente usado para tarefas de processamento de fala. Os espectrogramas são então armazenados como grandes matrizes de milhares de valores.

Mas essas matrizes são enormes e difíceis de processar. Assim, um auto codificador – uma rede neural otimizada para gerar codificações de dados eficientes a partir de grandes quantidades de dados – primeiro comprime o espectrograma em uma codificação de 30 valores. Em seguida, ele descompacta essa codificação em um espectrograma separado. Inteligência artificial

Basicamente, o modelo deve garantir que o espectrograma descomprimido se pareça com a entrada do espectrograma original. Ao fazer isso, ele é forçado a aprender a representação compactada de cada entrada de segmento de espectrograma sobre os dados de séries de tempo de cada sujeito. As representações compactadas são os recursos que ajudam a treinar modelos de aprendizado de máquina para fazer previsões.

Mapeamento de recursos normais e anormais

No treinamento, o modelo aprende a mapear esses recursos para “pacientes” ou “controles”. Os pacientes terão mais padrões de voz do que os controles. Em testes em assuntos nunca vistos, o modelo condensa de maneira semelhante todos os segmentos do espectrograma em um conjunto reduzido de recursos. Então, são regras majoritárias: se o assunto tem segmentos de voz anormais, eles são classificados como pacientes; se eles tiverem principalmente os normais, eles serão classificados como controles. Inteligência artificial

Em experimentos, o modelo foi executado com a mesma precisão dos modelos de última geração que exigem engenharia manual de recursos. É importante ressaltar que o modelo dos pesquisadores foi executado com precisão tanto no treinamento quanto no teste, indicando que está aprendendo padrões clinicamente relevantes dos dados, e não informações específicas do assunto.

Em seguida, os pesquisadores querem monitorar como vários tratamentos – como cirurgia e terapia vocal – afetam o comportamento vocal. Se os comportamentos dos pacientes se moverem de forma anormal para normal ao longo do tempo, eles provavelmente estão melhorando. Eles também esperam usar uma técnica similar nos dados do eletrocardiograma, que é usado para rastrear as funções musculares do coração.

Faça um comentário