Views: 50

– O sistema de imagem permite que os usuários experimentem roupas virtuais em tempo real

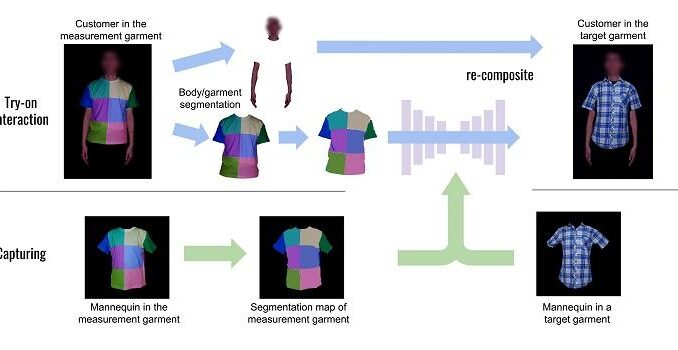

Cortesia da Universidade de Tóquio: Uma equipe de pesquisadores da Universidade de Tóquio criou uma maneira de as pessoas se visualizarem vestindo roupas às quais não têm acesso físico direto. O sistema de provador virtual usa um dispositivo de captura exclusivo e uma forma orientada por inteligência artificial (IA) para digitalizar peças de roupa.

Usando um sistema de imagem e exibição correspondente, um usuário pode então se ver em uma tela vestindo qualquer coisa do guarda-roupa digital, usando o provador virtual. Um motor de IA sintetiza imagens foto realísticas, permitindo que movimentos e detalhes como dobras e ondulações sejam vistos como se o usuário estivesse realmente usando a roupa virtual.

Comprar roupas pode ser difícil às vezes. Muitas vezes você chega à loja e eles estão fora do estilo ou tamanho da roupa que você pretendia experimentar. Muitas compras podem ser feitas online agora, mas comprar roupas pode ser difícil, pois é muito difícil julgar se algo vai caber em você ou se você vai gostar quando vir pessoalmente.

Para resolver essas questões, tem havido algumas tentativas ao longo dos anos para criar uma espécie de espelho digital que possa visualizar um usuário e sobrepor uma peça de roupa em cima dele. No entanto, esses sistemas carecem de funcionalidade e realismo.

O Professor Takeo Igarashi, do Grupo de Pesquisa de Interface do Usuário da Universidade de Tóquio, e sua equipe exploram diferentes maneiras pelas quais os humanos podem interagir com os computadores. Eles sentiram que poderiam criar seu próprio espelho digital que resolvesse algumas limitações dos sistemas anteriores. A resposta deles é o sistema de experimentação um provador virtual, e a equipe espera que ele possa mudar a forma como compramos roupas no futuro.

“O problema de criar um espelho digital preciso é duplo”, disse Igarashi. “Em primeiro lugar, é importante modelar uma ampla gama de roupas em diferentes tamanhos. E, em segundo lugar, é essencial que essas roupas possam ser sobrepostas de forma realista em um vídeo do usuário. Nossa solução é única na forma como funciona, usando um manequim robótico sob medida e uma IA de última geração que traduz roupas digitalizadas para visualização. ”

Para digitalizar roupas, a equipe projetou um manequim que pode se mover, expandir e contrair de diferentes maneiras para refletir diferentes poses e tamanhos corporais. Um fabricante precisaria vestir esse manequim robótico com uma roupa e, em seguida, permitir que ele percorresse uma variedade de poses e tamanhos enquanto as câmeras o capturassem de diferentes ângulos.

As imagens capturadas são enviadas para uma IA que aprende como traduzi-las para caber em um usuário ainda não visto. No momento, a captura da imagem de um item leva cerca de duas horas, mas depois que alguém veste o manequim, o resto do processo é automatizado.

“Embora o tempo de captura da imagem seja de apenas duas horas, o sistema de aprendizado profundo que criamos para treinar modelos para visualização posterior leva cerca de dois dias para ser concluído”, disse o estudante de graduação Toby Chong, um dos co-autores do artigo. “No entanto, este tempo diminuirá naturalmente à medida que o desempenho computacional aumentar.”

Em seguida, vem a interação do usuário. Alguém que deseja experimentar roupas diferentes precisa ir até a loja e ficar em frente a uma câmera e uma tela. Eles vestiam uma roupa especialmente feita com um padrão incomum chamado de vestimenta de medição.

O padrão é um arranjo não repetido de quadrados de cores diferentes. A razão para isso é que é fácil para um computador estimar como o corpo de alguém está posicionado no espaço de acordo com como esses quadrados coloridos se movem uns em relação aos outros. Conforme o usuário se move, o computador sintetiza uma imagem plausível da vestimenta que segue o movimento do usuário.

“Uma vantagem do nosso sistema é que a vestimenta virtual corresponde ao movimento da vestimenta de medição, incluindo coisas como rugas ou alongamento. Pode parecer muito realista, de fato ”, disse Igarashi. “No entanto, ainda existem algumas questões que queremos melhorar.

Por exemplo, no momento, as condições de iluminação no ambiente do usuário precisam ser rigidamente controladas. Seria melhor se pudesse funcionar bem em situações de raios menos controlados. Além disso, existem alguns artefatos visuais que pretendemos corrigir, como pequenas lacunas nas bordas das roupas. ”

A equipe tem várias aplicações possíveis em mente, sendo as compras online a mais óbvia, com um benefício colateral sendo que ela pode evitar uma grande quantidade de desperdício de moda, já que os compradores podem ter mais segurança sobre sua compra e as roupas podem até mesmo ser feitas sob demanda, em vez de no escala.

Mas a experimentação com o provador virtual, também pode ser usada no mundo do vídeo online, incluindo conferências e produção ambientes, onde a aparência é importante e os orçamentos são apertados.

Artigo relacionado: Software têxtil para acelerar o desenvolvimento de roupa

Faça um comentário